Персональные данные часто бывают высокой сложности. В качестве примера можно привести адресную информацию, внутренние документы, такие как постановление, приказ, акт. Их не так просто привести в обезличенный вид, не говоря уже о последующей чистке и стандартизации.

Статическое обезличивание, что это значит? На основе специальных правил создаётся копия базы данных, которые заменят исходную информацию на похожую, но не соответствующую действительности. Статистическое обезличивание наиболее часто применяется банками, чтобы понять, что происходит: где персональные данные и системы связаны между собой. Благодаря этому виду маскирования, каждая внешняя компания, которой будут доступны конфиденциальные данные, не сможет использовать их в своей работе вне контракта. Это обеспечивает и защиту данных, и возможность пользоваться этими данными при разработке.

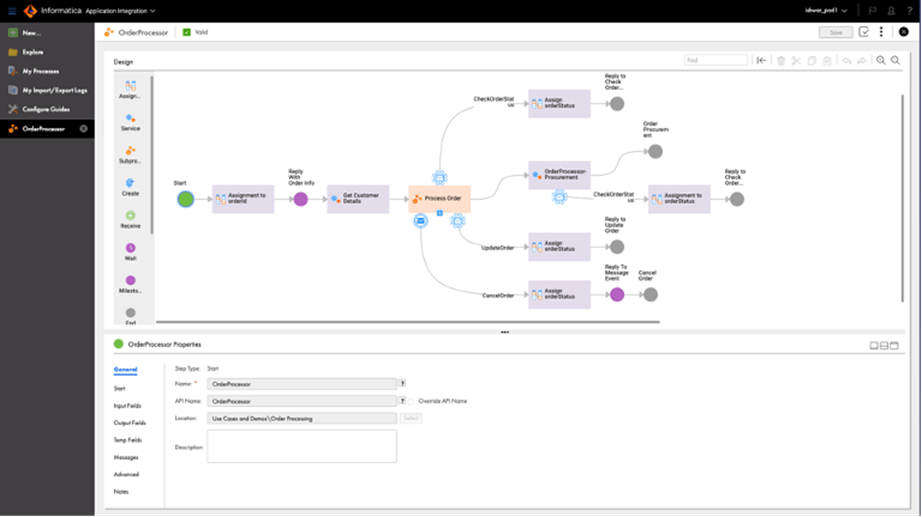

Обычно маскирование таких данных производится на основе интеграционных инструментов, позволяющих выделять домены: типы и категории данных, которые необходимо обезличить. Помимо этого для персональных данных сразу будет установлен один или несколько методов обезличивания:

- размывание — самый простой метод, при котором данные обобщаются на основе общих признаков или характеристик; применяется в основном для дат или сумм;

- перемешивание — перестановка отдельных записей или целых групп данных; таким образом обезличиваются фамилии, слова, регионы;

- перестановки — перемешивания данных внутри записи, например, цифр номера телефона;

- использование случайных механизмов: этот метод используют для каких-то сумм или дат в определенных пределах;

- шифрование;

- любые другие алгоритмы.

Важная задача при маскировании подобного набора данных — ведение единой модели обезличивания. То есть, если системы разного характера между собой связаны каким-то дополнительным интеграционным механизмом, который использует данные сразу из обеих систем, то при создании тестовых систем необходимо, чтобы значения, которые будут в полях одной системы, соответствовали полям другой.

Обычно в подобных решениях используется еще и профилирование, то есть изучение качества данных. Оно дает нам возможность понять, что содержится в этих данных, какого они качества, каким образом распределяется их наполнение и есть ли где-то экстремальные виды значений, на основании которых мы можем предположить, что в тестовую среду нужно заложить дополнительную выборку.

Если говорить о динамическом обезличивании данных, то его механизмы совсем другие. Основная задача здесь — не предоставить лишнюю информацию многочисленным пользователям. Для этого инструмент динамического обезличивания перехватывает запросы, поступающие в базу данных или другие системы, а затем оценивает необходимость предоставления запрашиваемых данных конкретному получателю. В случае, если у пользователя отсутствуют права доступа, запрос просто заменяется на другой, содержащий набор данных, который положен именно этому специалисту согласно предоставленным ему правам доступа.

Также существует отдельный вид решений, который выполняет категоризацию критичных данных. Оно помогает понять, где во всех системах лежат данные, попадающие под категорию персональных, коммерческой тайны или любого другого типа ограничений и обратить внимание, каким образом эти данные защищены, а также предложить дополнительные варианты по усилению их безопасности. Кроме того, категоризация критичных данных обычно работает в связке с системами класса SIEM. Это системы, которые определяют какой пользователь к каким данным обращался, при том, выявляя аномалии, когда специалист не той категории получил доступ к критичным данным, которые ему не положены по правам.

Таким образом, учитывая увеличение числа кибератак, а также растущий объем информации в корпоративных базах данных, компаниям необходимы современные решения, обеспечивающие сохранность конфиденциальной информации, задавая стандарт безопасности для всей корпоративной информации. Обезличивание персональных данных ограничивает использование критических данных внешними поставщиками, позволяя при этом организациям разрабатывать системы с информацией, максимально приближенной к реальным записям.

Автор: Олег Гиацинтов, технический директор DIS Group