Примеры использования ETL

ETL-системы широко используются в самых разных сферах, особенно среди банков, телекоммуникационных корпораций, на предприятиях.

Дирекция Региональных Продаж Нефть» построила озеро данных с помощью систем ETL. Такое озеро имеет два ландшафта (тестовый и продуктивный) и три зоны («Сырой слой» для хранения копий данных из источников, «Продуктивная фабрика данных» с фокусом на оптимизацию, производительность и управление, «Исследовательская лаборатория» для задач прототипирования аналитических моделей) с разным уровнем управления данными. В каталоге данных производится паспортизация источников данных, таблиц и витрин, разметка данных по доменам с помощью настроенных шаблонов, профилирование данных. Как результат, более 50% аналитических проектов и инициатив реализуются в контуре озера данных, затраты на интеграцию данных и аналитические проекты снизились за счет централизованных инфраструктуры и сервисов, возросла и доступность данных, что положительно повлияло на эффективность работы аналитиков. Изначально задачи озера данных включали в себя обработку транзакций сети АЗС компании, расчет сегментов для клиентской аналитики и анализ обратной связи от клиентов. Позднее в озеро были интегрированы данные из других источников: Санкт-Петербургской товарно-сырьевой биржи, географических и метеорологических ресурсов, метрики и отзывы Google, «Яндекс» и др.

В банковской сфере ETL широко применяется для интеграции данных о партнерах и клиентах. Промсвязьбанк использует возможности ETL-системы для унификации информации о партнёрах банка и чёрных списков клиентов. Эти данные используются, чтобы оптимизировать операционную деятельность при взаимодействии с партнёрами. Информация о них консолидирована и интегрирована из разных источников в единое хранилище. Это ускорило получение информации о партнерах и позволило избежать ошибок из-за неточных данных. Унификация «черных списков» клиентов понадобилась, чтобы снизить риски банка в области мошенничества клиентов и оптимизировать работу с проблемными клиентами и неплательщиками. При формировании «чёрных списков» данные интегрировались из систем («Экстремисты», «Недействительные паспорта», K4Loans) и передавались в банковские системы PSB-Retail и др.

Банк ВТБ использовал ETL-систему для создания целевого единого хранилища, чтобы эффективно управлять информационными активами банка. ETL применяется компанией для интеграции и синхронизации данных в проекте и для миграции данных в новые приложения, обмена информацией с контрагентами. В итоге была создана единая аналитическая экосистема и платформа для управления информационными активами банка. Она представляет собой сервис, адаптированный под работу с регламентами и требованиями по доступности данных в рамках большого MPP-кластера, способного масштабироваться в любой момент времени.

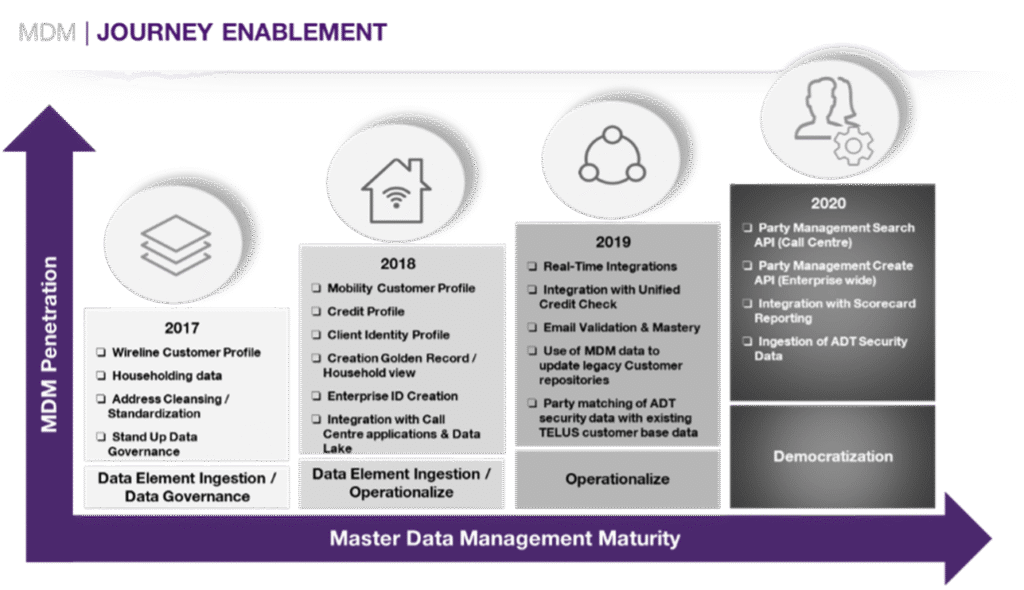

В телекоммуникационном бизнесе использование ETL также широко распространено. «ВымпелКом» использовал ETL, чтобы быстрее вывести новый продукт на рынок. Интеграция данных понадобилась, когда «ВымпелКом» завершил сделку по приобретению 100% пакета акций компании «Голден Телеком». На основе ее продуктов был создан бренд «Билайн бизнес» для обслуживания корпоративных пользователей. Процесс интеграции компании «Голден Телеком» в информационную среду «ВымпелКом» потребовал интеграции системы 1С и финансовой системы «ВымпелКом» Oracle E-Business Suite. Решения ETL справились с этой задачей, поэтому поглощение «Голден Телеком» компанией «ВымпелКом» прошло легче, а новый сервис удалось быстрее вывести на рынок.

С помощью ETL оператор мобильной связи Tele2 повысил качество клиентского опыта. В проекте провели миграцию данных для кампаний целевого маркетинга и аналитических запросов пользователей. Теперь эта информация регулярно обновляется, в результате компания стала эффективнее привлекать новых клиентов и удерживать текущих. Также была скорректирована стратегия развития бизнеса: стала возможна детализация стратегических показателей и автоматизированное формирование отчетов.

В индустрии сельского хозяйства решения ETL не менее эффективны. Группа компаний «АгроТерра» использовала их для интеграции данных из ERP, ГИС, CRM и других систем (они не были синхронизированы между собой и не предполагали автоматический обмен информацией). Также ETL обеспечивает обмен мастер-данными по всей группе компаний. Мастер-данные – ключевая информация по основным бизнес-объектам компании, которая регулярно совместно используется большим количеством бизнес-процессов. Благодаря ETL качество отчетов увеличилось и принимать управленческие решения стало проще.

Решения ETL используются и в сфере культуры. Один из лидеров российского рынка онлайн-кинотеатров Ivi.ru обладает большим каталогом фильмов, мультфильмов и сериалов. Компании необходимо было создать аналитическую платформу для оптимизации развития бизнеса, сократить количество финансовых и временных издержек, связанных с получением отчетов, обеспечить корректное и быстрое перемещение информации для ее использования в критически важных процессах подготовки отчётности. Система ETL помогла быстро осуществить миграцию данных из СУБД, NoSQL в целевые хранилища Vertica и Yandex Clickhouse. В результате работы унифицированы процессы загрузки и преобразования данных, создана единая система мониторинга процесса загрузки данных в хранилища, что повысило прозрачность получения данных. Это позволило бизнесу своевременно получать необходимые данные для подготовки финансовой отчетности, а также снизить затраты на техподдержку.

Чем дольше работает компания, тем большее количество данных образуется, и их необходимо отслеживать и анализировать. Когда рабочих рук для этого не хватает, помогают ETL-решения. И это их главное преимущество. Они автоматически передают информацию в хранилище из разных источников, структурируют ее и повышают качество данных для аналитики.